AFP 지원이 종료 된 후 언젠가부터 네트워크 드라이브의 백업이 진행되지 않는 문제가 발생했다. 그간 신경 안쓰다가 백업 안한지 너무 오래되어 몇시간 헤딩하면서 해결 방법을 찾게되었다.

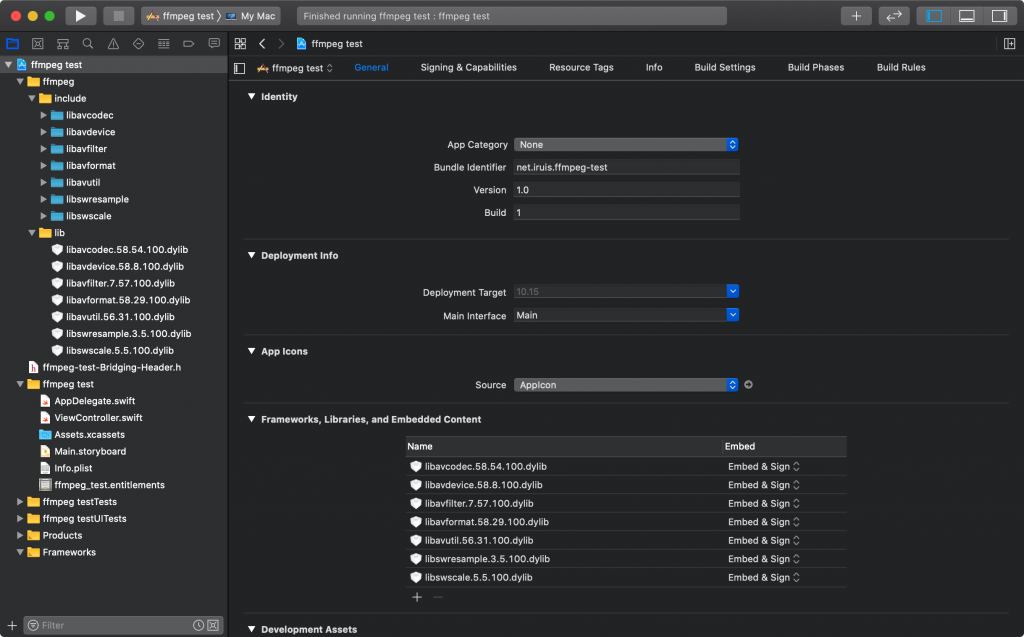

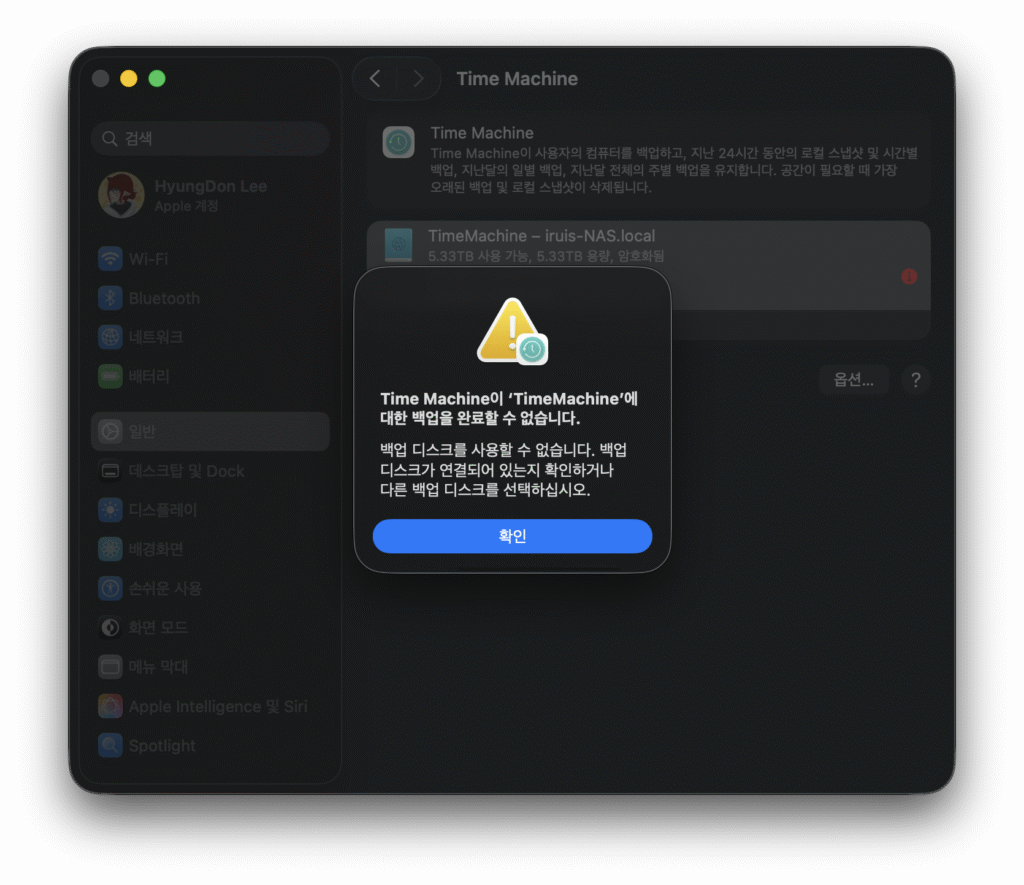

아래는 증상이 나타나는 화면

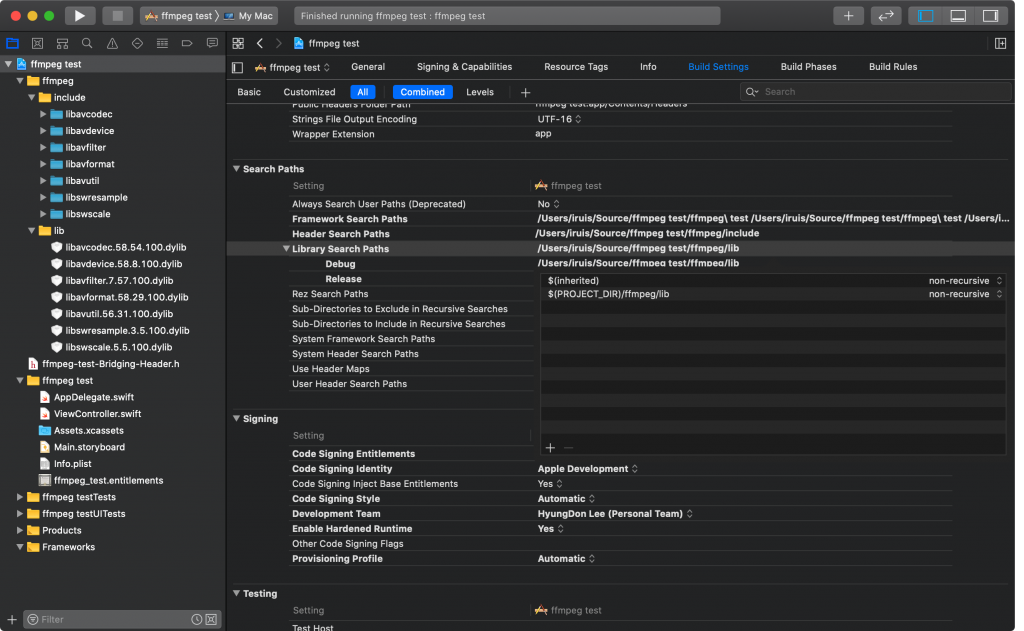

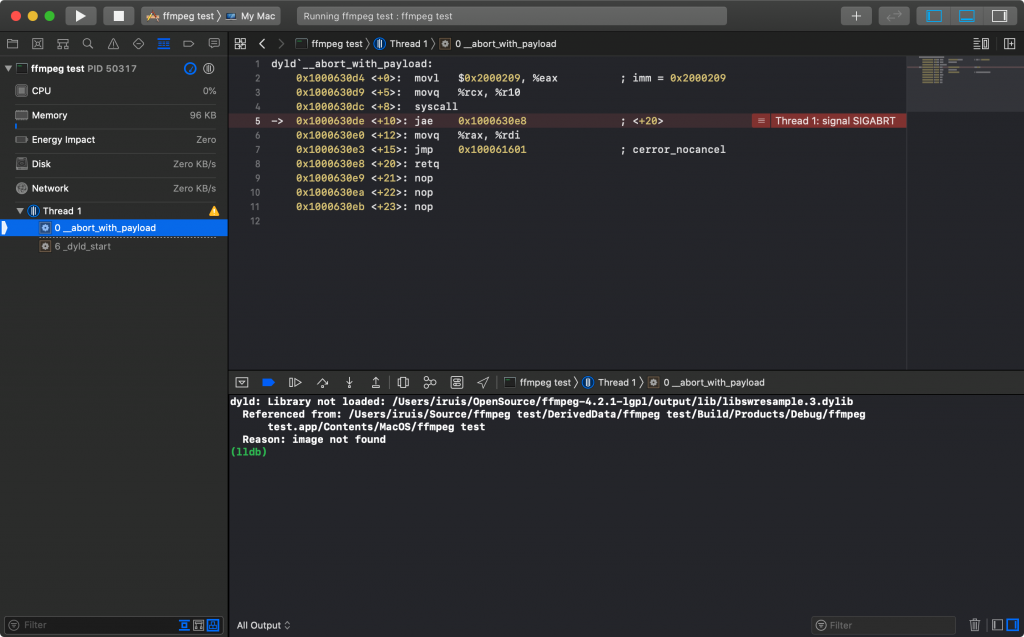

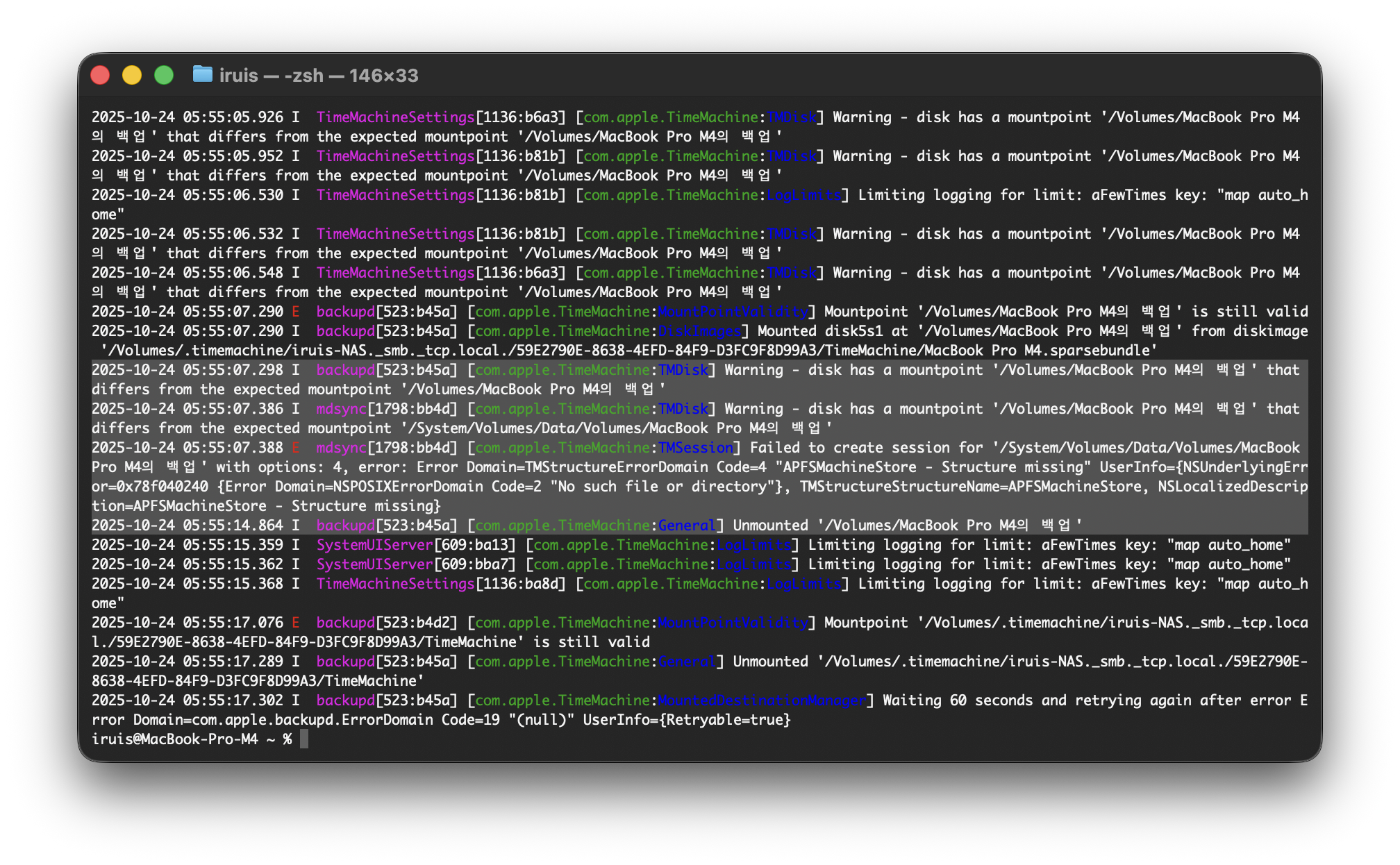

SMB로 전환 후 한동안 백업이 되었던거같은데… 어느날 백업 안된지 오래되었다는 알람이 발생하여 확인하니 저렇게 타임머신 백업이 계속 실패했었다. 구글링을 통하여 알게 된 log show --info --style compact --predicate '(subsystem == "com.apple.TimeMachine")' --last 5m 명령으로 타임머신 로그 메시지 조회를 해보았다.

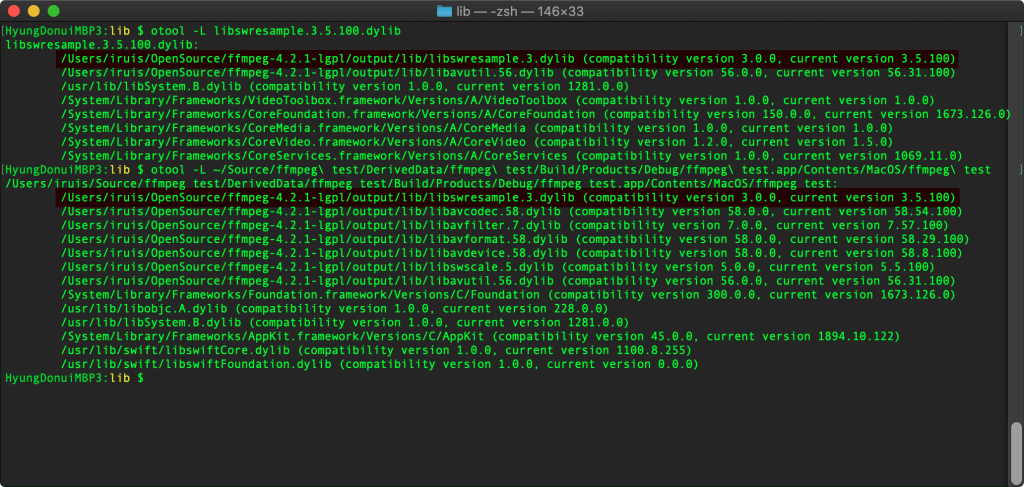

ChatGPT에 로그 메시지를 넣어서 해결법을 요구하니 “의 백업” 문구의 한글 인코딩에 차이가 있다는 결과를 알려주었다. (맥에서 기본적으로 한글을 처리할 때 풀어쓰기를 사용하기때문에 발생하는 버그인지 서로 불일치가 일어난거같다. 분명 잘 되던 백업이 어느날 부터 안되는걸 보면 AFP 지원 종료 후 뭔가 잘못 건든게 있는 듯 하다.)

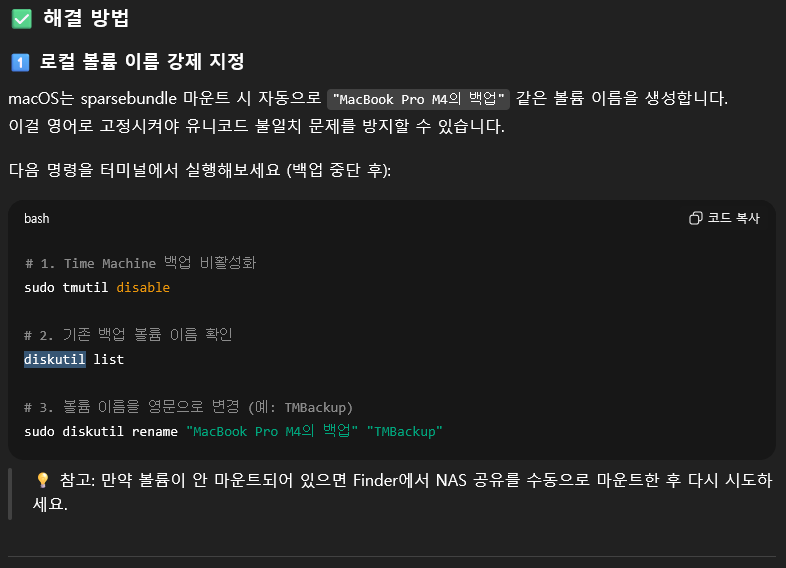

ChatGPT에서는 명령줄로 변경하는 방법을 제시하였지만…

백업이 끝나면 마운트 해제되므로 위 내용 그대로 할 수 없다. 핵심은 백업 미디어의 볼륨 이름을 바꾼다는 것이므로 아래와 같은 방법으로 변경했다. 참고로 새로운 백업을 생성 한 경우 백업 실패 메시지 까지 떠야 한다.

Continue reading macOS(맥OS)의 타임머신 백업이 안될경우 해결 법